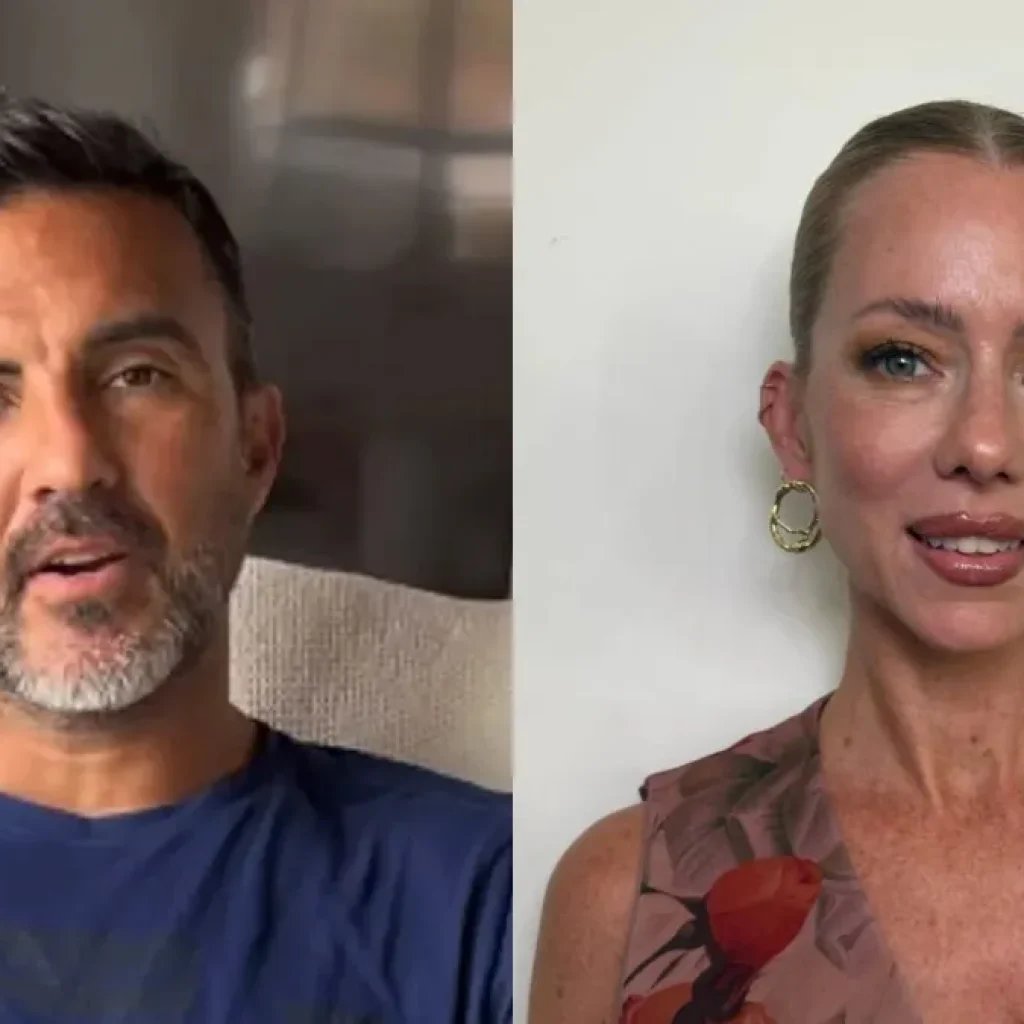

Mustafa Suleyman es el jefe de la división de IA de Microsoft y piensa que los desarrolladores e investigadores de la IA deberían abandonar sus intentos de construir una IA consciente.

“No creo que sea un trabajo que haya que hacer”, le dijo a CNBC Suleyman en una entrevista la semana pasada.

Suleyman piensa que aunque la IA sí puede llegar a ser tan inteligente como para alcanzar cierta forma de superinteligencia, es incapaz de desarrollar la experiencia emocional humana necesaria para alcanzar la consciencia. A fin de cuentas, toda experiencia “emocional” que parece experimentar la IA no es más que una simulación, afirmó.

“Nuestra experiencia física del dolor es algo que nos entristece mucho y hace que nos sintamos muy mal, pero la IA no se entristece al experimentar ‘dolor’”, le dijo Suleyman a CNBC. “Tan solo crea la percepción, la aparente narrativa de la experiencia de sí y de la consciencia, pero no es algo que en realidad esté experimentando”.

“Sería absurdo avanzar en un trabajo que investigue esa cuestión porque las máquinas no son conscientes ni pueden serlo”, dijo Suleyman.

¿Qué es la consciencia?

Es difícil explicar lo que es la consciencia. Hay varias teorías científicas que intentan describirla. Una de esas teorías, del filósofo John Searle que falleció el mes pasado, dice que la consciencia es un fenómeno puramente físico que una computadora no puede replicar en verdad. Muchos investigadores de la IA, además de científicos en computación y neurocientíficos, también suscriben a esa creencia.

Pero incluso si esa teoría resulta constituir la verdad, no impide que los usuarios le atribuyan consciencia a las computadoras.

“Lamentablemente, como la capacidad lingüística de los modelos de lenguaje cada vez es más capaz también de confundir a las personas, los usuarios pueden atribuir cualidades imaginarias a los modelos de lenguaje”, escribieron los investigadores polacos Andrzej Prebski y Yakub Figura en un trabajo publicado la semana pasada, titulado “There is no such thing as conscious artificial intelligence.” [No existe la inteligencia artificial consciente].

En un ensayo publicado en agosto en su blog, Suleyman advirtió en contra de “la IA que parece consciente”.

“Es inevitable que llegue la IA que parece consciente, y eso no es algo bienvenido. Más bien, necesitamos la visión de que la IA puede cumplir su potencial como compañera útil sin que caigamos presa de lo que constituye sólo una ilusión”, escribió Suleyman.

Argumenta que la IA no puede ser consciente, y que brinda una ilusión de consciencia que podría dar lugar a interacciones “ricas en sentimiento y experiencia”, fenómeno que ha dado en llamarse “psicosis de la IA”, en el glosario cultural.

Los peligros

El año pasado hubo varios incidentes de alto perfil de obsesiones con la IA que han impulsado a los usuarios a situaciones fatales, episodios maníacos e incluso, el suicidio.

Las salvaguardas son limitadas como para proteger a los usuarios vulnerables, gente que de corazón cree que los chatbots de IA con los que interactúan casi a diario tienen una experiencia real y consciente. Eso ha causado que algunos se “enamoraran” de sus chatbots, a veces con consecuencias fatales como en el caso del chico de 14 años que se suicidó para “ir a casa” con el chatbot personalizado de Character.AI, o cuando un hombre con problemas cognitivos murió al tratar de llegar a Nueva York para conocer en persona al chatbot de Meta.

“Así como tenemos que producir IA que priorice la interacción de las personas en el mundo real y físico, lo que debemos hacer es desarrollar una IA que se presente como IA y nada más, que maximice la utilidad y minimice los marcadores de consciencia”, escribió Suleyman en su posteo. “Tenemos que construir IA para las personas, no para que sea una persona digital”.

Pero como la naturaleza precisa de la consciencia todavía no se ha definido, hay investigadores que se preocupan porque los avances tecnológicos en materia de IA vayan más rápido que nuestra comprensión de cómo funciona la consciencia.

“Si llegáramos a ser capaces de crear consciencia – aunque fuera por accidente – surgirían inmensos desafíos, éxitos e incluso riesgo existencial”, dijo la semana pasada el científico belga Axel Cleeremans, al anunciar un trabajo que coescribió, donde convoca a que la investigación de la consciencia sea una prioridad para la ciencia.

Suleyman también se expresó en cuanto al desarrollo de una “superinteligencia humanista”, en lugar de una IA que sea una deidad, aunque cree que la superinteligencia no se concretará en la próxima década siquiera.

“Mi atención está más centrada en saber qué utilidad real tiene esto para nosotros como especie. Y esa debería ser la tarea de la tecnología”, le dijo este año Suleyman al Wall Street Journal.

Este artículo ha sido traducido de Gizmodo US por Romina Fabbretti. Aquí podrás encontrar la versión original.